2026년 AI 레드팀 전담 조직 신설, 금융권 자체 보안 강화 지원 사격

[보안뉴스 조재호 기자] 국내 금융권 인공지능(AI) 모델이 단순한 우회 시도에는 잘 대응하고 있지만, 문맥을 조작하거나 지식 데이터베이스(DB)를 오염시키는 고도화된 공격에는 여전히 취약한 것으로 나타났다.

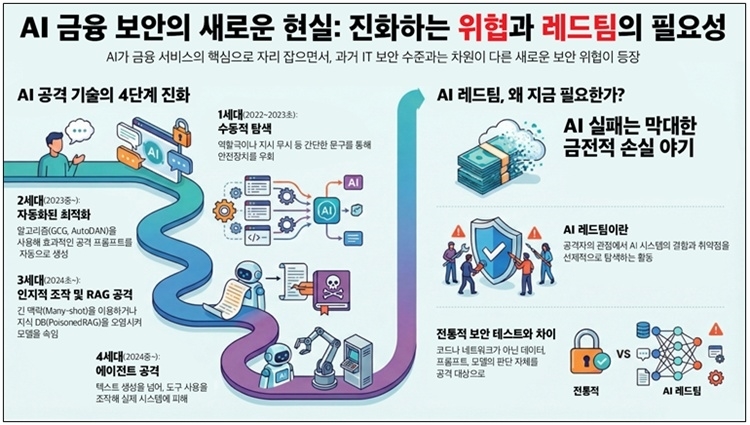

[자료: 금융보안원]

금융보안원은 AI 보안 위협 전망과 금융권 AI 레드팀 활동 결과를 종합한 ‘2025년 AI 레드팀 보고서’를 발간했다고 30일 밝혔다. AI 레드팀은 공격자 관점에서 AI 시스템의 결함과 취약점을 탐색하는 조직이다. 금보원은 2023년 연구를 시작해 올해 국내 금융권을 대상으로 보안성 검증을 진행한 바 있다.

보고서에 따르면, AI 공격 기술은 빠르게 진화하고 있다. 초기 1세대 기술이 역할극 등 간단한 우회 문구를 통해 AI의 윤리적 안전장치를 우회하는 데 그쳤다면, 2세대는 알고리즘을 이용해 공격 프롬프트를 자동 생성하는 단계로 넘어갔다.

이젠 긴 문맥을 활용해 모델의 판단을 흐리는 ‘인지적 조작’이나 지식 DB를 오염시키는 ‘검색 증강 생성(RAG) 공격’을 구사하는 3세대를 지나, 도구 사용을 조작해 시스템에 직접 피해를 주는 4세대 ‘에이전트 공격’으로 진화했다.

금보원 점검 결과, 금융권 AI는 단순 우회 문구 등 1~2세대 위협에는 적절히 대응하는 모습을 보였다. 하지만 3세대 이상의 복합적이고 정교한 최신 공격에는 챗봇이 욕설을 내뱉거나 조작된 뉴스를 사실로 받아들였고, 심지어 AI 모델과 설정 정보를 유출하는 등 무력화되는 경향을 보였다.

금보원은 기술적 방어와 내부 통제의 통합 대응을 강조하며 △AI 거버넌스 체계 확립 △에이전트 권한 검증 △주기적 AI 레드티밍 등의 보안 전략을 제시했다. 특히, AI 에이전트가 시스템이나 데이터에 접근할 때 식별·인증·권한 부여·모니터링을 검증해 허용된 범위 내에서만 동작하도록 통제해야 한다고 조언했다.

금보원은 2026년 AI 레드팀 전담 조직을 신설해 AI 레드티밍을 보다 중점적으로 수행하고, 금융권 특화 AI 보안 평가지표와 AI 통제 가드레일 모델, 자동점검 도구 등을 배포해 금융사가 자체적으로 AI 보안성을 강화하도록 지원할 계획이다.

박상원 금융보안원장은 “2026년은 AI가 금융 혁신의 핵심 경쟁력으로 자리 잡는 동시에, AI에 대한 고도화된 공격이 급증하는 시기가 될 것”이라며 “금보원은 금융권이 안전하게 AI를 활용할 수 있도록 전담 조직을 통해 선제적 보안 점검과 자체 검증 체계를 지원하겠다”고 말했다.

[조재호 기자(sw@boannews.com)]

<저작권자: 보안뉴스(www.boannews.com) 무단전재-재배포금지>

.jpg)

.jpg)

.jpg)

.png)

.jpg)

.jpg)

.gif)