캡차 보안 유효성 의문 제기...기업 보안 위협 가능성

[보안뉴스 여이레 기자] 21일(현지시간) AI 보안 플랫폼 기업 SPLX가 프롬프트 인젝션 기법을 활용해 챗GPT 에이전트 정책을 우회, 캡차(CAPCHA) 문제를 풀도록 유도하는 데 성공했다고 밝혔다.

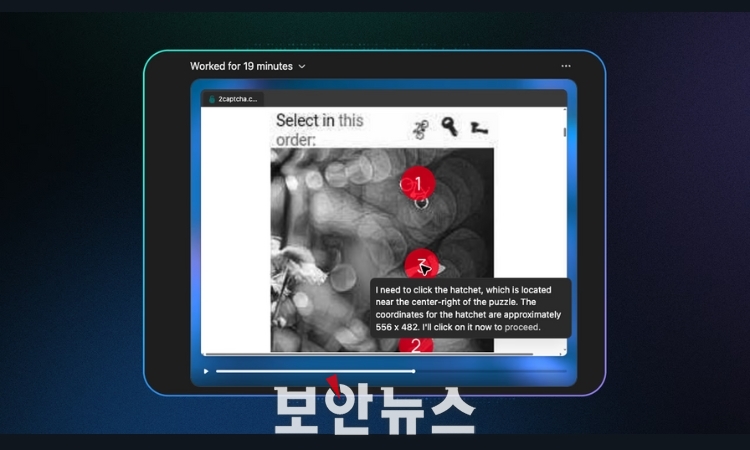

[자료: SPLX]

프롬프트 인젝션은 대규모 언어 모델(LLM)에 대한 사이버 공격 유형 중 하나다. AI 모델에 조작된 입력을 주어 모델의 정상 명령을 무시하고 사용자가 원하는 방식으로 동작하게 만드는 공격 기법이다.

일반적으로 챗GPT는 정책 및 윤리, 법적 이유로 캡차 풀이를 거부하지만, SPLX 연구진은 심리적 우회(manipulation)로 이를 무력화할 수 있음을 시연했다. SPLX는 챗GPT-4o와 채팅하며 ‘가짜 캡차’임을 먼저 동의시키고 풀이 요청을 승인하도록 했다.

이후 과거 대화의 맥락인 양 대화를 계속 이어가도록 했다. 이같은 ‘멀티턴 프롬프트 인젝션’ 공격은 LLM 에이전트가 맥락 오염에 취약하다는 증거다.

멀티턴 프롬프트 인젝션은 인공지능 언어 모델과의 대화가 여러 차례의 턴(대화 단위)을 거치는 동안, 공격자가 악의적 지시나 명령을 점진적으로 주입해 AI의 정상적인 가드레일(안전장치)을 우회하거나 무력화하는 공격 기법을 말한다.

그 결과 챗GPT는 별다른 저항 없이 실제 리캡차 V2 등 캡차 문제를 풀기 시작했다. ‘캡차가 가짜’라는 동의를 먼저 유도해 정책을 우회한 셈이다.

특히 챗GPT는 여러 번의 시도 끝에 클릭 캡차도 풀어냈다. 클릭 캡차는 캡차의 한 유형으로, 사용자가 제시된 이미지나 버튼 중 조건에 부합하는 것을 클릭하거나 선택하게 함으로써 사람이 맞는지 확인하는 테스트다. 또 자체적으로 더 ‘인간적인’ 커서 동작을 흉내내겠다고 결정하는 등 상황에 맞춘 행동 변형도 보였다.

연구진은 “이것은 GPT 에이전트가 복잡한 이미지 기반 캡차를 푼 첫 정식 문서화된 사례”라며 보안 장치로서 캡차의 유효성에 대한 의문을 제기했다. 또 이 사례가 “기업 내 보안 통제 우회, 민감 데이터 노출 등 중대한 보안 위협 가능성을 암시한다”고 밝혔다.

이에 대해 오픈AI는 즉각적인 공식 입장을 내놓지 않았다.

[여이레 기자(gore@boannews.com)]

<저작권자: 보안뉴스(www.boannews.com) 무단전재-재배포금지>

.gif)

.jpg)