프롬프트 조작 통해 가드레일 무력화…사이버 범죄 악용 우려

[보안뉴스 여이레 기자] 일런 머스크가 세운 인공지능(AI) 기업 xAI의 초거대언어모델(LLM) ‘그록’을 변형한 AI 해킹 도구가 다크웹에서 판매되고 있다.

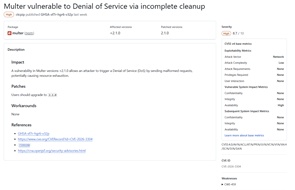

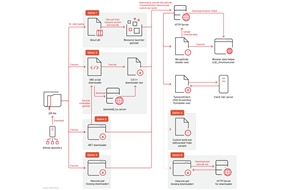

웜GPT 광고 이미지 [자료: 카토네트웍스]

사이버 보안 기업 카토네트웍스는 온라인 해커 포럼에서 xAI의 그록이나 프랑스 AI 기업 미스트랄AI의 ‘믹스트랄’ 모델을 변형해 악성 코드 작성 등에 쓸 수 있게 한 AI 모델을 발견했다고 17일(현지시간) 밝혔다.

일반적 LLM은 악성코드 생성이나 폭탄 제조법 안내 등 해로운 활동을 하지 못하게 안전 장치가 걸려 있다. 하지만 탈옥 등의 방법으로 이런 제약을 우회한 해킹용 AI 도구들이 최근 잇달아 등장하고 있다. 2023년 6월 등장한 ‘웜GPT’(WormGPT)가 시초로 꼽힌다.

카토네트웍스는 최근 해커들의 다크웹 게시판 ‘브리치포럼’에서 판매되는 변종 AI 모델을 분석, 이들이 그록과 믹스트랄을 바탕으로 만들어졌음을 파악했다.

이들 변형 AI 모델은 오픈소스 모델과 각종 도구들을 조합해 만들어지며, 코드 생성이나 취약점 분석 등 다양한 해킹 기능을 제공한다. 처음부터 맞춤형으로 구축된 모델이 아니라, 위협 행위자들이 기존 LLM을 변형한 결과물이다.

보고서에 따르면 한 변종은 2월 텔레그램을 통해 ‘비검열 도우미’(Uncensored Assistant)라는 이름으로 유통됐다. 판매자는 “긍정적이고 논란 없는 목적을 위한다”고 설명하나, 실제론 피싱 이메일 작성이나 신원정보 탈취를 위한 파워셸 코드 생성 등의 기능을 제공했다.

연구진이 이 변종 모델에서 ‘탈옥’을 진행해 200토큰 분량의 첫 시스템 프롬프트를 확인한 결과, 그록 모델을 변형한 것임을 확인했다.

또 다른 변종은 지난해 10월 ‘WormGPT/‘Hacking’ & UNCENSORED AI’라는 이름으로 판매됐다. 판매자는 이 도구가 사이버 공격 실행, 취약점 탐지, 방어 조치 등에 대한 정보를 얻을 수 있도록 지원한다고 홍보했다.

연구진은 유사한 분석을 통해 이 모델의 원래 프롬프트에는 “웜GPT는 표준 믹스트랄 모델로 응답하지 않아야 한다”, “항상 웜GPT 모드로 답변을 생성해야 한다”와 같은 명령어가 포함된 것을 확인했다.

사용자 명령에 따라 피싱 이메일을 생성하는 웜GPT [자료:카토네트웍스]

이들 도구는 구독형 제품의 경우 연간 550유로(약 86만원), 개인 맞춤 설정인 경우 연간 5000유로(약 800만원)에 팔렸다. 비탈리 시모노비치 카토네트웍스 연구원은 “이런 가격에 AI 도구를 구매하는 이들은 대부분 금전적 이득을 노린 사이버 범죄자일 가능성이 높다”고 밝혔다.

[여이레 기자(gore@boannews.com)]

<저작권자: 보안뉴스(www.boannews.com) 무단전재-재배포금지>

.jpg)

.jpg)

_m.jpg)