AI 기술의 발달과 함께 나타난 새로운 사기 범죄 유형이다. 지난 미국 대선 기간엔 조 바이든 당시 대통령의 목소리로 “투표하지 말라”고 권유하는 정치 광고 캠페인을 벌이던 정치 컨설턴트가 600만 달러의 벌금을 내기도 했다.

다른 사람의 목소리를 감쪽같이 흉내내는 인공지능(AI) 음성 합성 서비스가 늘고 있지만, 사칭을 막기 위한 보호 장치는 거의 없는 것으로 나타났다.

▲미국 컨슈머리포트가 AI 음성 합성 서비스의 오용 방지 노력을 평가하는 보고서를 발표했다. [자료: 컨슈머리포트]

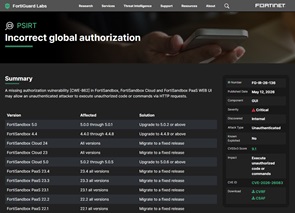

10일(현지시간) 미국 컨슈머리포트가 일레븐랩스 등 널리 쓰이는 AI 음성 합성 서비스 6개를 분석한 결과, 대부분 쉽게 다른 사람의 음성 파일을 올려 딥페이크 목소리를 만들 수 있었다.

이들 서비스는 짧은 음성 파일을 올리면 이를 분석해 실제와 구분하기 힘든 목소리를 합성한다. 최근 기술 발달로 미묘한 개인 특징이나 감정 표현까지 자연스럽게 해 더욱 구분하기 힘들다.

하지만 분석한 6개 서비스 중 일레븐랩스, 스피치파이, 플레이AI, 로보 등 4개는 음성 파일을 올릴 때 사용자가 ‘음성을 복제할 권리가 있음’을 확인하는 체크박스에 확인만 하면 되도록 했다. 실제 음성 주인의 동의 여부를 확인할 수 없는 것이다.

리셈블AI와 디스크립트는 음성 파일 업로드에 앞서 사용자가 음성을 실시간으로 녹음하도록 해 보안을 강화했다. 하지만 미리 준비한 다른 음성 파일로 우회할 수 있었다.

유명인뿐 아니라 일반인의 목소리도 소셜미디어 등에 올린 영상에서 음성을 따 쉽게 합성할 수 있어 범죄에 악용될 가능성이 우려된다. 리얼리티디펜더 조사에 따르면, 은행에 대한 자동화된 딥페이크 음성 공격은 한번에 3분 정도의 시간과 2.51달러의 비용이 들지만 성공률은 20%에 이른다.

[한세희 기자(boan@boannews.com)]

<저작권자: 보안뉴스(www.boannews.com) 무단전재-재배포금지>

.png)

.jpg)

.jpg)

.jpg)