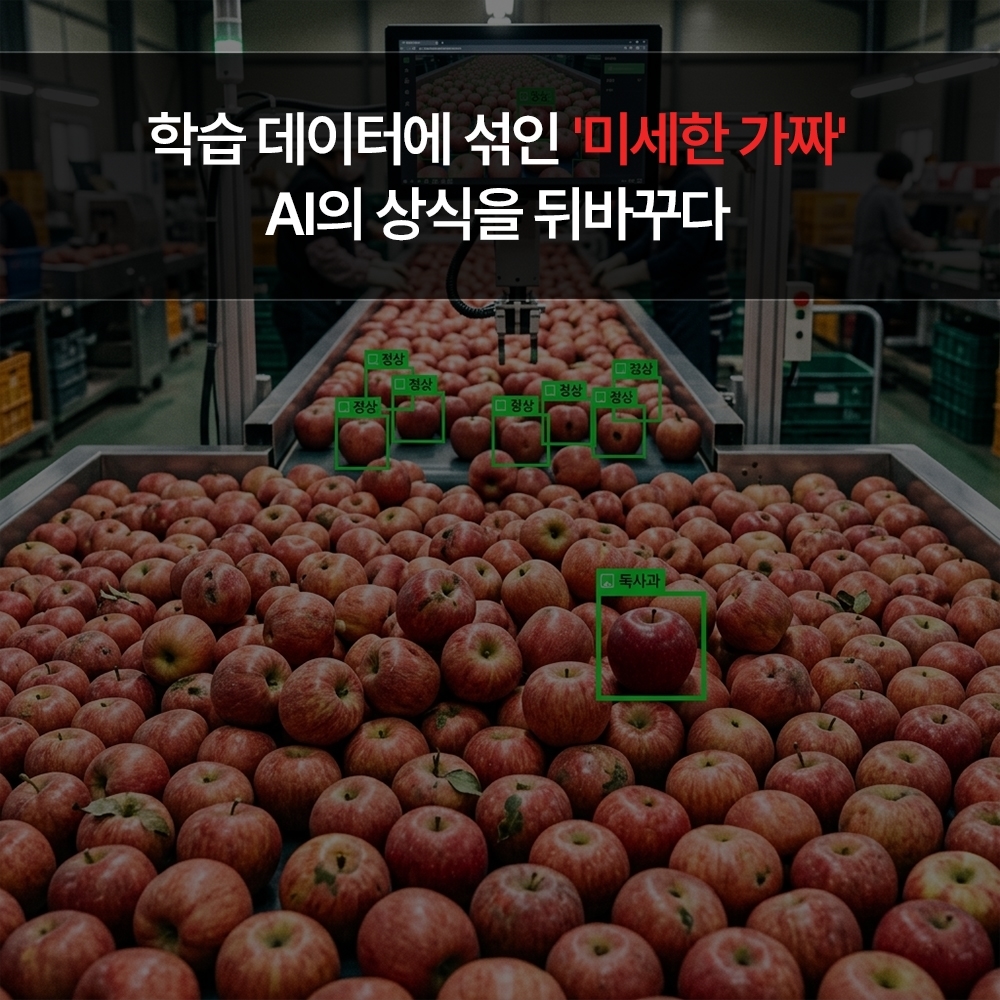

AI 모델의 학습 데이터에 악성 데이터를 교묘하게 주입하여 저작권 침해, 차별, 가짜 뉴스 등 잘못된 결과물을 도출하게 만드는 ‘데이터 포이즈닝’ 공격이 새로운 보안 위협으로 부상했다. 해커는 AI의 기술적 결함보다는 내재된 ‘편향성’을 무기로 삼아 겉보기엔 멀쩡하지만 실제로는 오염된 ‘좀비 AI’를 만들어 기업의 신뢰를 무너뜨릴 수 있다. AI 보안 사고를 막기 위해서는 학습 데이터의 출처와 무결성을 상시 검증하는 ‘AI 거버넌스’ 체계를 구축하고, 보안 패러다임을 입력값 감시 중심으로 전환해야 한다.

[지진솔 기자(digital@boannews.com)]

<저작권자: 보안뉴스(www.boannews.com) 무단전재-재배포금지>

.gif)

.jpg)

.jpg)