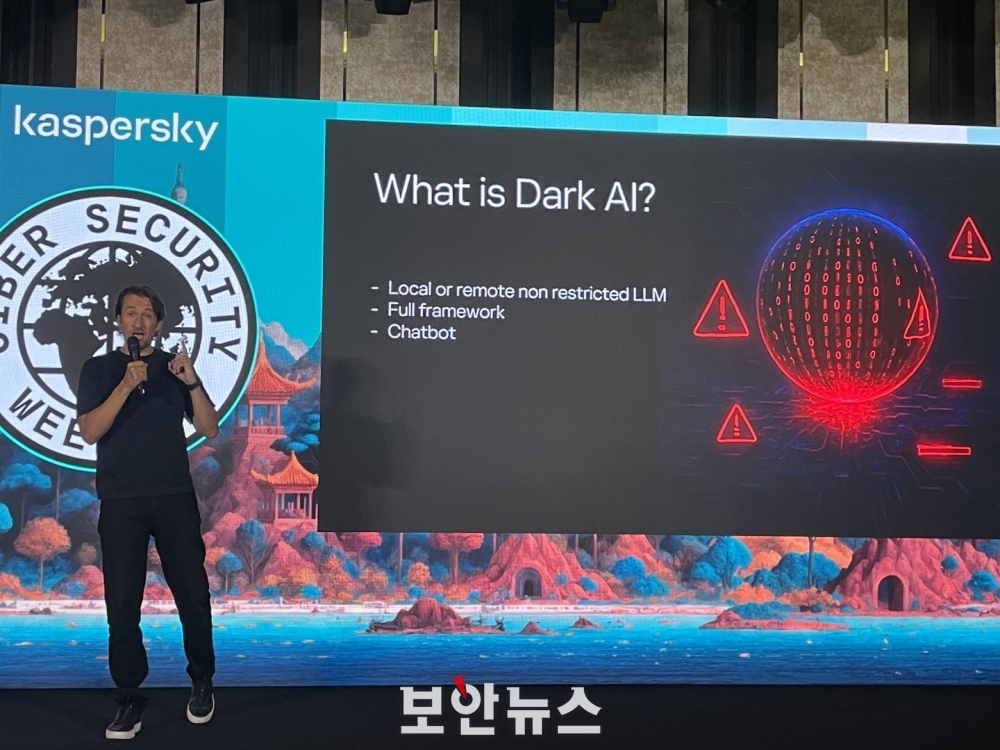

[베트남 다낭= 보안뉴스 한세희 기자] 세르게이 로츠킨 카스퍼스키 아시아태평양 및 중동 지역리서치센터장은 5일(현지시간) 베트남 다낭에서 열린 ‘카스퍼스키 사이버 시큐리티 위크엔드(CSW) 2025’ 행사에서 “챗GPT가 출시된 2023년 이후 사이버 범죄자들이 생성형 AI를 활용해 범죄 역량을 높이는 현상이 뚜렷해지고 있다”며 ‘다크 AI’(Dark AI)의 위험을 경고했다.

다크 AI란 사이버 환경에서 악성 코드 생성 등 비윤리적 행동을 하도록 제약을 풀어 둔 AI 모델을 말한다. 일반적인 AI 모델이 범죄 또는 비윤리적 행동을 막기 위해 각종 안전 장치를 둔 반면, 다크 AI는 이러한 제약에서 자유롭다.

▲로츠킨 카스퍼스키 센터장이 AI를 악용한 사이버 공격 트렌드에 대해 발표하고 있다. [자료: 보안뉴스]

AI가 일반적인 업무나 창작의 생산성을 크게 끌어올린 것처럼 다크 AI는 사이버 범죄자의 역량을 크게 높여준다. 악성 코드와 피싱 메일을 더 빨리, 더 많이, 더 설득력 있게 만들 수 있게 된다.

로츠킨 센터장은 “일단 보안 솔루션에 탐지된 멀웨어를 다시 탐지를 피하도록 수정하려면 사이버 범죄자 입장에서 많은 시간과 노력이 필요했다”며 “이젠 AI가 코드를 즉각 변경해 탐지를 피하는 변종을 만들어낸다”고 말했다. 이는 오랜 시간에 걸쳐 지속적으로 특정 목표를 공략하는 지능형지속공격(APT) 그룹에 큰 무기를 쥐어 주는 셈이다.

실제로 챗GPT 출시 이후 웜GPT(Worm GPT)나 다크바드(Dark Bard), 프로드GPT(Fraud GPT), 잔트로픽(Xanthropic) 같은 사이버 범죄에 특화된 생성형 AI 모델들이 쏟아져 나오고 있다. 이들은 방대한 분량의 악성코드 데이터로 학습돼 멀웨어 코딩과 피싱 메일 작성에 최적화된 성능을 보여준다.

언어적 한계를 극복할 수 있다는 점도 큰 위협이다. 로츠킨 센터장은 “기존 피싱 공격은 현지 언어에 익숙하지 않은 외국 해커들이 어색한 표현을 쓰기 때문에 상대적으로 탐지가 쉬웠다”며 “생성형 AI 모델은 완벽하게 자연스러운 문장을 만들기 때문에 속기 쉽다”고 말했다. AI가 뛰어난 성능의 악성 코드, 설득력 있는 피싱 메일을 쓰는 것이다.

딥페이크 음성과 영상을 활용한 공격도 AI 기술이 가져오는 새로운 위협이다. 로츠킨 센터장은 “최근 회사 직원들 얼굴과 음성을 딥페이크 기술로 생성해 줌 화상회의에서 사기를 친 사건이 있었다”며 “이제 동영상은 더 이상 믿을 수 없는 것이 되었다”고 말했다.

[자료: 카스퍼스키]

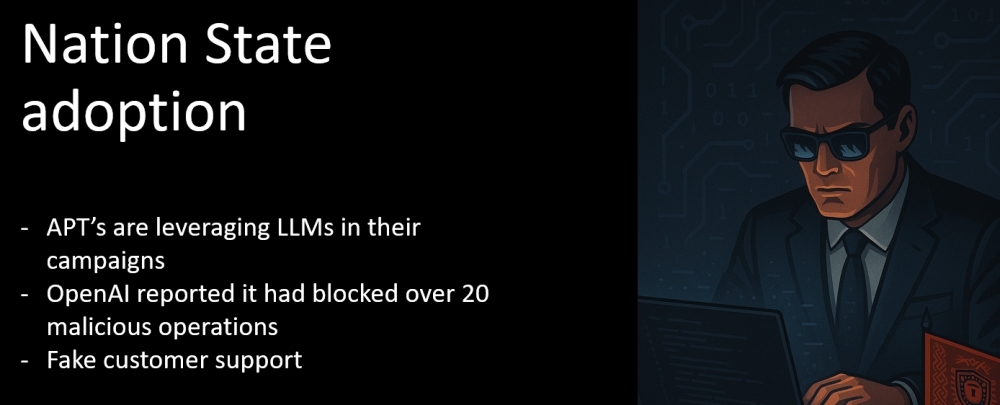

특히 국가 지원을 받는 공격자 집단이 생성형 AI 모델 활용에 본격적으로 나서는 우려스러운 추세가 나타나고 있다는 경고다. 로츠킨 센터장은 “올해 들어 국가 지원 공격자 그룹들에서 생성형 AI를 활용해 공격을 계획하거나 실제 수행하는 일이 늘어나는 추세”라며 “제미나이 같은 AI 모델을 활용하는 국가 지원 공격자 집단이 40여 곳에 이른다”고 말했다.

오픈AI 역시 최근 챗GPT를 사이버 공격에 악용하는 국가 지원 공격자 그룹 20여 곳을 차단했다고 밝힌 바 있다.

로츠킨 센터장은 보안 연구자 역시 생성형 AI를 적극 활용해야 한다고 강조했다. AI는 “공격자에게 창인 동시에 보안 담당자에게 방패가 될 수 있다”는 설명이다. 그는 “나 역시 보안 연구자로서 위협을 탐지하고, 방어 수단을 만드는데 생성형 AI 기술을 적극 활용하고 있다”며 “AI로 방어 수단을 개발하지 않으면 공격자와의 경주에서 뒤쳐질 것”이라고 말했다.

카스퍼스키 내부에서도 LLM 기반 생성형 AI를 적극 활용하고 있다. 로츠킨 센터장은 “위협을 찾고, 식별하고, 제거하는 일과 악성코드의 작동 원리를 파악하는 일 등에 생성형 AI를 활용하고 있다”며 “이를 통해 사이버 위협에 더 잘 대처해 싸울 수 있다”고 말했다.

[베트남 다낭=한세희 기자(boan@boannews.com)]

<저작권자: 보안뉴스(www.boannews.com) 무단전재-재배포금지>

.jpg)

.jpg)

.jpg)

.jpg)

.jpg)

.jpg)

.jpg)