[보안뉴스 강현주 기자] 구글 제미나이 등 주요 상용 거대언어모델(LLM)들이 사용하는 ‘전문가 혼합’(MoE) 구조가 새로운 보안 위협이 될 수 있다는 사실을 한국과학기술원(KAIST) 연구진이 규명했다.

26일 KAIST는 전기및전자공학부 신승원 교수와 전산학부 손수엘 교수 공동연구팀이 전문가 혼합 구조 악용 공격 기법을 세계 최초로 규명한 논문(MoEvil: Poisoning Experts to Compromise the Safety of Mixture-of-Experts LLMs)으로 CSAC 2025에서 최우수논문상을 수상했다고 밝혔다.

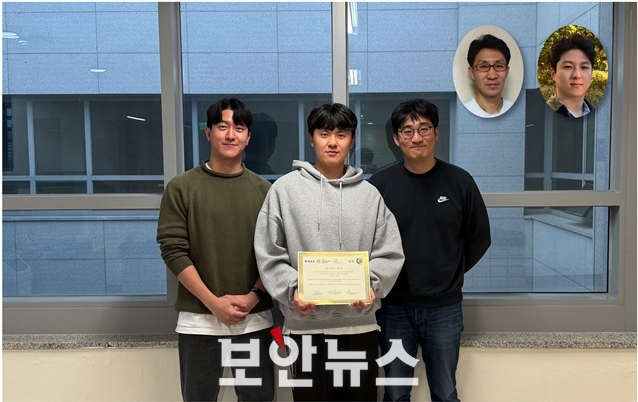

▲(왼쪽부터) KAIST 송민규 박사과정 김재한 박사과정 손수엘 교수 (오른쪽 상단) 신승원 교수 나승호 책임연구원 [자료: KAIST]

전문가 혼합은 효율성을 높이기 위해 여러 개의 ‘작은 AI 모델(전문가 AI)’를 상황에 따라 선택해 사용하는 전략을 활용하고 있다. 그러나 이 구조가 오히려 새로운 보안 위협이 될 수 있다.

ACSAC(Annual Computer Security Applications Conference)는 정보보안 분야에서 가장 영향력 있는 국제 학술대회 중 하나다. 올해 전체 논문 가운데 단 2편만이 최우수논문으로 선정됐다. 국내 연구진이 인공지능 보안 분야에서 이 같은 성과를 거둔 것은 매우 이례적이다.

연구팀은 이번 연구에서 전문가 혼합 구조의 근본적인 보안 취약성을 체계적으로 분석했다. 특히 공격자가 상용 거대언어모델의 내부 구조에 직접 접근하지 않더라도, 악의적으로 조작된 ‘전문가 모델’ 하나만 오픈소스로 유통될 경우, 이를 활용한 전체 거대언어모델이 위험한 응답을 생성하도록 유도될 수 있음을 입증했다.

정상적인 AI 전문가들 사이에 단 하나의 ‘악성 전문가’만 섞여 있어도, 특정 상황에서 그 전문가가 반복적으로 선택되며 전체 AI의 안전성이 무너질 수 있다는 것이다. 이 과정에서도 모델의 성능 저하는 거의 나타나지 않아, 문제를 사전에 발견하기 어렵다는 점이 특히 위험한 요소로 지적됐다.

실험 결과, 연구팀이 제안한 공격 기법은 유해 응답 발생률을 기존 0%에서 최대 80%까지 증가시킬 수 있었다. 다수의 전문가 중 단 하나만 감염돼도 전체 모델의 안전성이 크게 저하됨을 확인했다.

이번 연구는 세계적으로 확산되고 있는 오픈소스 기반 거대언어모델 개발 환경에서 발생할 수 있는 새로운 보안 위협을 최초로 제시했다는 점에서 큰 의미를 갖는다. 동시에, 앞으로 AI 모델 개발 과정에서 성능뿐 아니라 ‘전문가 모델의 출처와 안전성 검증’이 필수적임을 시사한다.

이번 연구에는 KAIST 전기및전자공학부 김재한·송민규 박사과정, 나승호 박사 (현 삼성전자), KAIST 전기및전자공학부 신승원 교수, KAIST 전산학부 손수엘 교수가 참여했으며, 연구 결과는 지난 12일 미국 하와이에서 열린 ACSAC에서 발표됐다. 이 연구는 과학기술정보통신부의 한국인터넷진흥원(KISA) 및 정보통신기획평가원(IITP)의 지원을 받았다.

신승원·손수엘 교수는 “효율성을 위해 빠르게 확산 중인 전문가 혼합 구조가 새로운 보안 위협이 될 수 있음을 이번 연구를 통해 실증적으로 확인했다”며 “이번 수상은 인공지능 보안의 중요성을 국제적으로 인정받은 의미 있는 성과”라고 말했다.

[강현주 기자(jjoo@boannews.com)]

<저작권자: 보안뉴스(www.boannews.com) 무단전재-재배포금지>

.jpg)

.png)

.png)

.png)